Исследования в области искусственного интеллекта сегодня находятся на передовом крае науки и занимают одно из важных мест в работе ученых Национального исследовательского ядерного университета "МИФИ" (НИЯУ МИФИ). Какие разработки сегодня ведутся в этой сфере? Что стоит за желанием ученых научить машину творчеству? Об этом в дни работы XX Международной научно-технической конференции "Нейроинформатика-2018" корреспонденту проекта "Социальный навигатор" МИА "Россия сегодня" рассказал профессор Института интеллектуальных кибернетических систем (НИЯУ МИФИ) Алексей Самсонович.

— Алексей Владимирович, некоторое время назад вы рассказывали про создание виртуального помощника композитора. Вас привлекает моделирование творческого мышления?

Для успеха искусственного интеллекта в целом необходима его совместимость с людьми. Они должны воспринимать его как равного партнера, а не как средство для достижения целей. Такое возможно только на основе взаимопонимания.

А то, что в данный момент я сфокусировался на творчестве, – это, скорее, промежуточный шаг. Конечная цель для меня – не творчество и не искусственный интеллект, занимающийся искусством (хотя это, безусловно, важная и интересная задача). Это лишь звено на цепочке шагов к искусственному интеллекту человеческого уровня.

В этом направлении в мире сегодня уже сделано немало, и трудно было бы превзойти эти достижения. Но мы и не пытаемся этого сделать, потому что наш подход совершенно другой, он основан на когнитивной архитектуре, а не на нейросетях, как у большинства других исследователей. Там цели достигаются фактически без какого-либо понимания механизмов творческого процесса человека, что не позволяет созданному искусственному интеллекту двигаться дальше того, ради чего он был создан. А наш подход основан на том, что решая определенную задачу, мы выясняем общие принципы и вырабатываем понимание, позволяющее нам решать следующие задачи.

— Входит ли в ваши планы создание виртуального художника?

— Я дал нескольким студентам такую задачу. Идея у нас была простая. В начале XX века творил известный художник, один из основателей абстракционизма, Пит Мондриан. Многие из его высоко оцененных картин представляют собой прямоугольники, разбитые на большое количество меньших прямоугольников разного цвета.

— Когда вы всему научите искусственный интеллект, и он вступит в эмоциональный и интеллектуальный контакт с человеком, как это можно будет использовать?

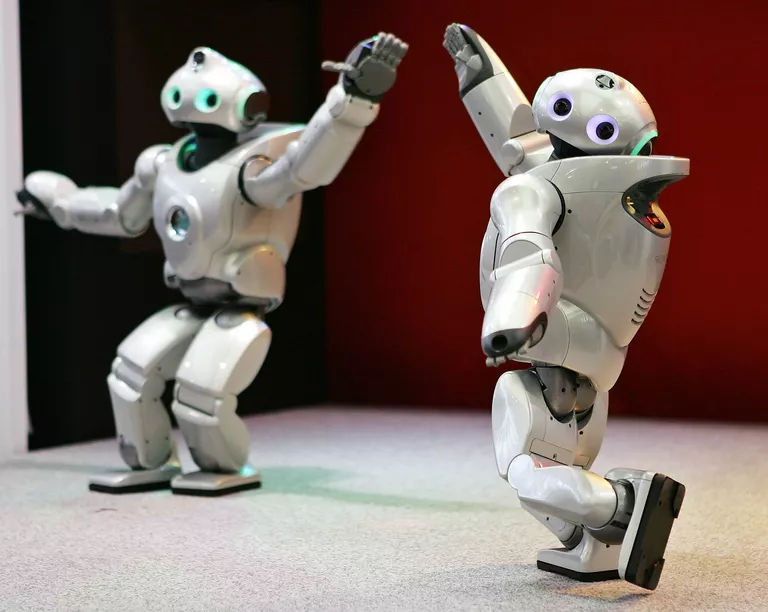

— Я думаю, что это будет использовано повсюду. Через три года, а то и раньше, все интеллектуальные средства, даже операционная система компьютера или смартфона, будут обладать элементами эмоционального интеллекта. Смартфоны уже сейчас позволяют нам в сообщениях передавать эмоции, и даже распознают их на лице человека. Я не знаю, насколько это полезно, но может быть, это нравится людям.

Я отчасти даже доволен, что все повально увлечены глубокими нейросетями, потому что если бы они, так же как и я, увлеклись когнитивными архитектурами, мне бы пришлось заниматься чем-то другим.

— Вы не боитесь, что эмоционально обученная машина в какой-то момент начнет проявлять не те эмоции, которые от нее ждут, и скажет: "У меня нет настроения работать"?

— Хотите верьте, хотите нет, но на Западе исследователи ставят именно такую цель – создать интеллектуальные агенты, которые способны восстать против своего хозяина. Считается, что это полезно, потому что иначе они не смогут отказаться от глупых заданий.

Когда я услышал об этом впервые от своего шефа четыре года назад, я спросил: "Чем это отличается от лифта, который не едет, когда вы нажимаете кнопку?" Он рассмеялся и сказал: "Надеюсь, что в нашем здании такого не случится".

— Нет ли здесь какой-то опасности?

— А каких-нибудь приятных для человечества открытий в этой сфере вы ждете в ближайшие годы?

— Да, конечно. Я думаю, многие сейчас ждут "большого прорыва" в искусственном интеллекте. По-моему, для этого прежде всего должно измениться отношение человека к искусственному интеллекту. Недавно на лекции меня спросили: "Зачем искусственному интеллекту эмоции, если нам от него нужно только, чтобы он наилучшим образом решил поставленную перед ним задачу?" Я считаю, что именно в такой постановке вопроса и кроется ошибка: искусственный интеллект должен сам найти задачу, которую нужно решить, и должен сам поставить ее. При этом он должен восприниматься нами как интеллектуально равный партнер, с которым можно взаимодействовать как с равным, на принципах доверия и взаимопонимания.

Находясь под контролем человека, искусственный интеллект все же должен действовать в значительной степени самостоятельно. Или он должен быть неким дополнением человека, его ассистентом или расширением человеческого мозга.